2026智能体算力升级趋势,DualPath架构带来的推理性能变革

当前大模型推理架构面临着前所未有的压力,随着应用范式从简单对话向智能体自主交互转变,系统负载特性发生了根本性的变化。这种演进路径要求底层架构必须具备更强的数据吞吐能力和更低的延迟表现。假设推理系统的瓶颈在于数据读取而非计算能力,那么针对KV-Cache的存储机制进行重构,将成为解决问题的关键逻辑。

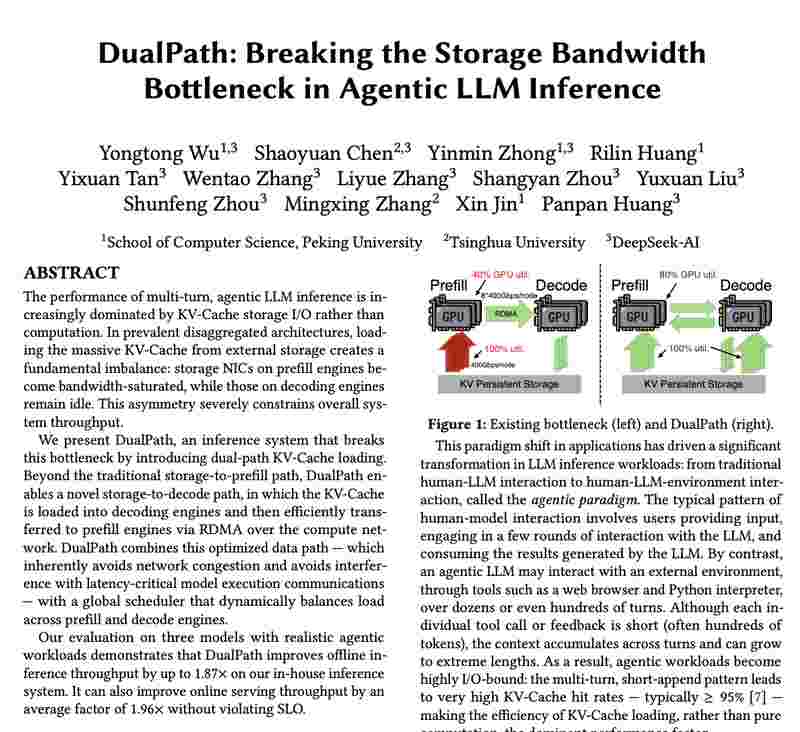

逻辑推理显示,在大模型作为智能体运行的过程中,交互轮次可达数百轮,导致上下文信息累积至极值。在现有系统中,负责预处理的引擎往往占用了全部网卡带宽,而负责生成内容的解码引擎却处于闲置状态,造成了严重的资源浪费。这种架构上的失衡,直接限制了在线服务的并发处理能力。

针对上述问题,DualPath系统通过引入双路径读取机制,成功实现了存储网络负载的重新分配。实验数据显示,该机制能够将离线推理吞吐量提升接近一倍,在线服务的智能体运行效率也有了显著增长。这种设计思路本质上是利用软件层面的优化,规避了硬件带宽的物理限制,从而在不增加额外算力投入的前提下,实现了性能的跃升。

分析表明,此类工程化创新在降低AI运营成本方面具有深远的战略意义。随着大模型应用场景的不断扩展,Token生成成本直接关系到相关企业的盈利能力与服务普及率。通过优化底层数据流,降低单次推理的计算资源消耗,是推动行业从技术验证迈向规模化产业应用的重要驱动力。

结论显示,未来的AI系统竞争力将不再局限于单一的模型参数规模,而是取决于系统工程的精细化运营水平。随着DeepSeek等团队在工程化领域的持续深耕,未来大模型推理架构将向着更加高效、低耗的方向演进。这种技术趋势不仅为硬件厂商提供了优化方向,也为AI产业的全面普及奠定了坚实的底层支撑。

行业算力瓶颈的突破路径

算力资源的利用率提升,直接关系到大模型企业的生存周期与市场竞争力。

DualPath机制展示了软件优化在硬件受限情况下的巨大潜力,为行业提供了参考范式。

未来AI系统的核心竞争力,将从单纯的参数规模竞争,转向系统工程与底层架构的精细化运营。